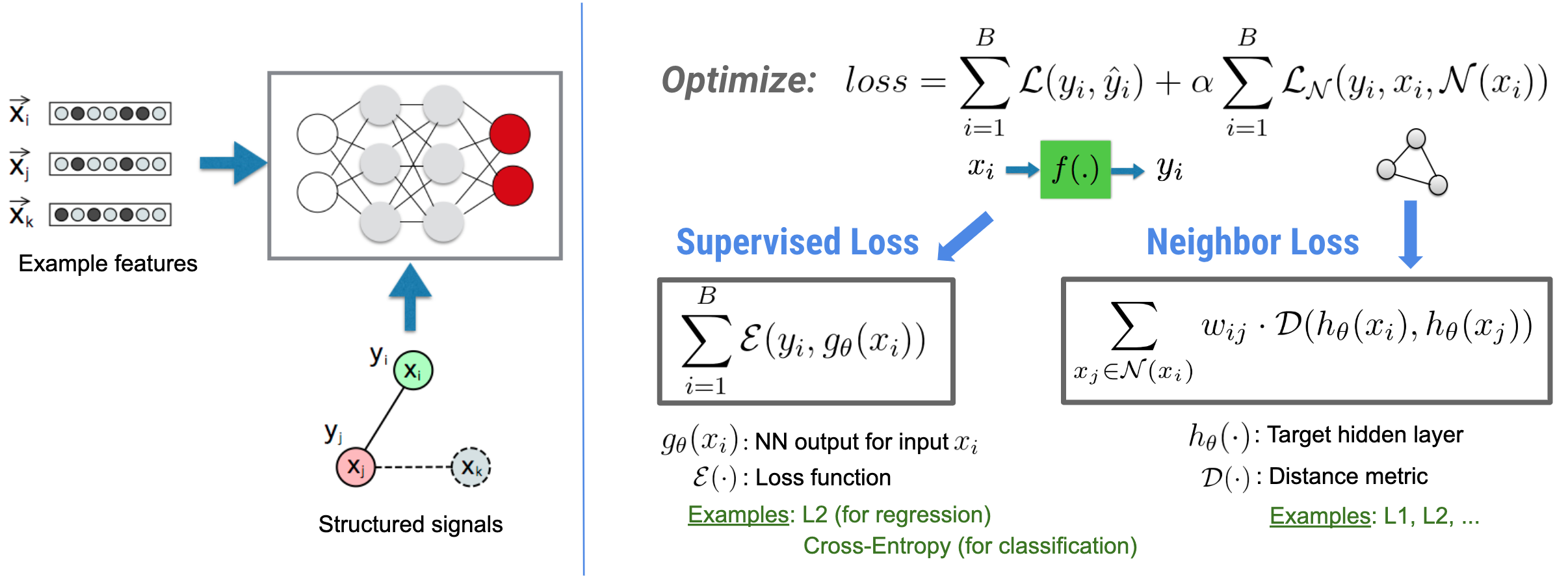

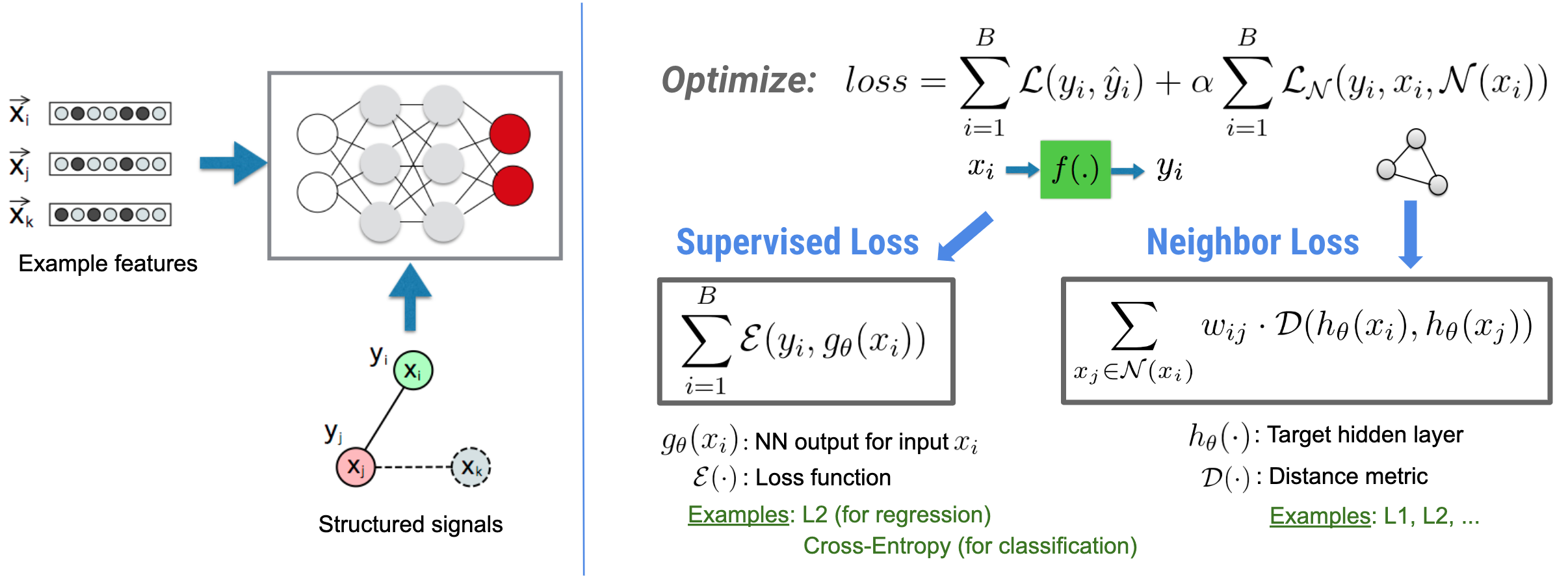

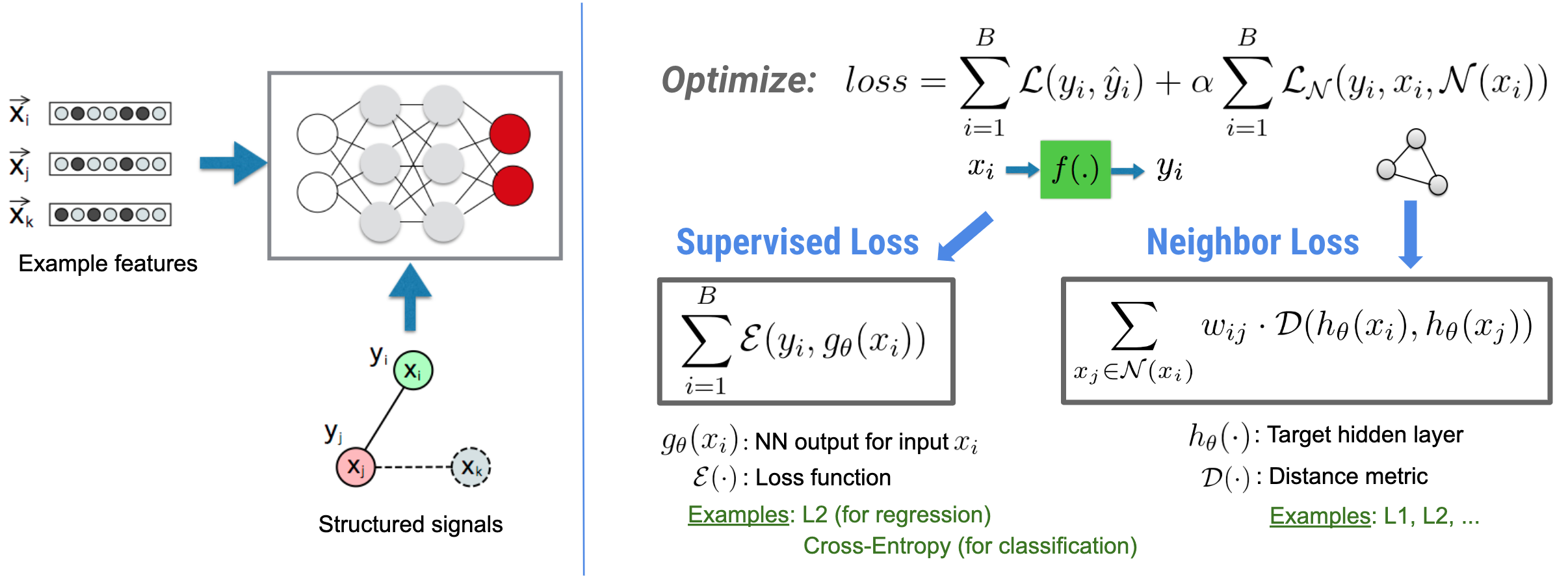

למידה מובנית עצבית (NSL) מתמקדת באימון רשתות עצביות עמוקות על ידי מינוף אותות מובנים (כאשר זמינים) יחד עם כניסות תכונות. כפי שהציגו Bui et al. (WSDM'18) , האותות המובנים הללו משמשים להסדרת האימון של רשת עצבית, מה שמאלץ את המודל ללמוד תחזיות מדויקות (על ידי מזעור אובדן מפוקח), ובו בזמן לשמור על הדמיון המבני של הקלט (על ידי מזעור אובדן השכן) , ראה את האיור למטה). טכניקה זו היא גנרית וניתנת ליישום על ארכיטקטורות עצביות שרירותיות (כגון Feed-Forward NNs, Convolutional NNs ו-NNs Recurrent).

שימו לב שמשוואת אובדן השכנים המוכללת היא גמישה ויכולה להיות בעלת צורות אחרות מלבד זו שהוצגה לעיל. לדוגמה, אנחנו יכולים גם לבחור\(\sum_{x_j \in \mathcal{N}(x_i)}\mathcal{E}(y_i,g_\theta(x_j))\) להיות הפסד השכן, שמחשב את המרחק בין האמת הקרקעית \(y_i\)והתחזית מהשכן \(g_\theta(x_j)\). זה משמש בדרך כלל בלמידה יריבות (Goodfellow et al., ICLR'15) . לכן, NSL מכליל ללמידת גרפים עצביים אם שכנים מיוצגים במפורש על ידי גרף, וללמידה אדוורסרית אם שכנים נגרמות באופן מרומז על ידי הפרעה אדוורסרית.

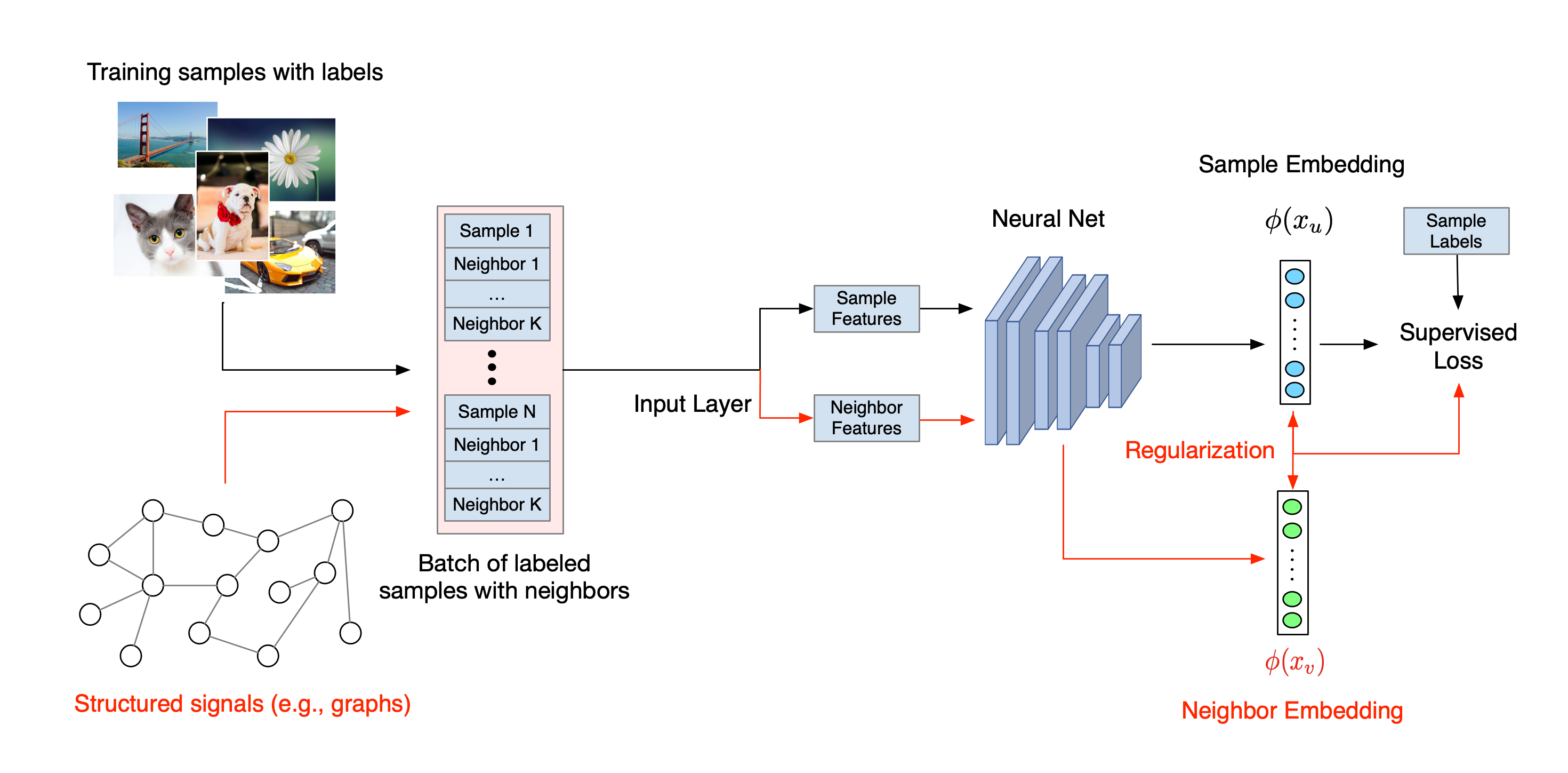

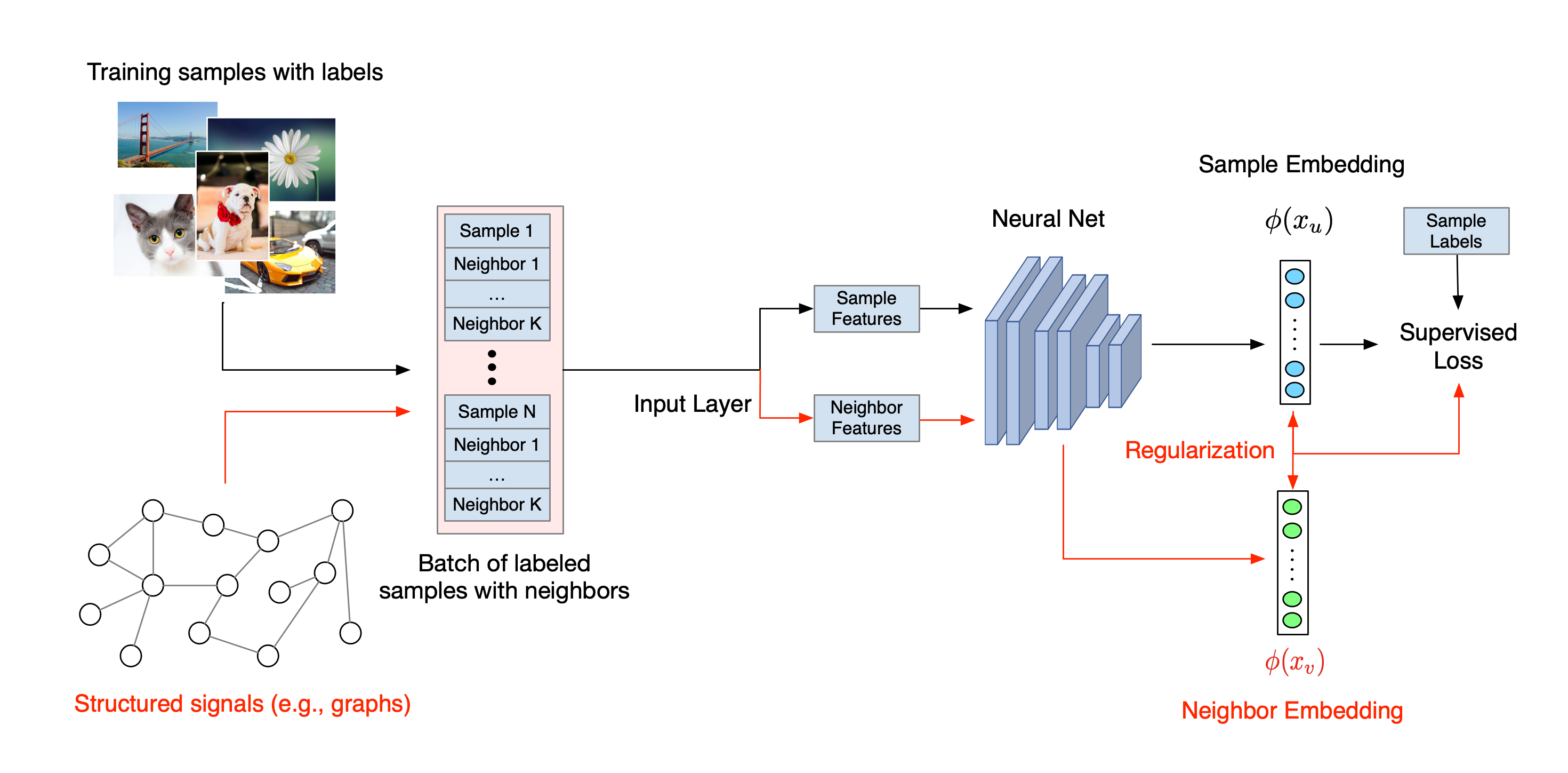

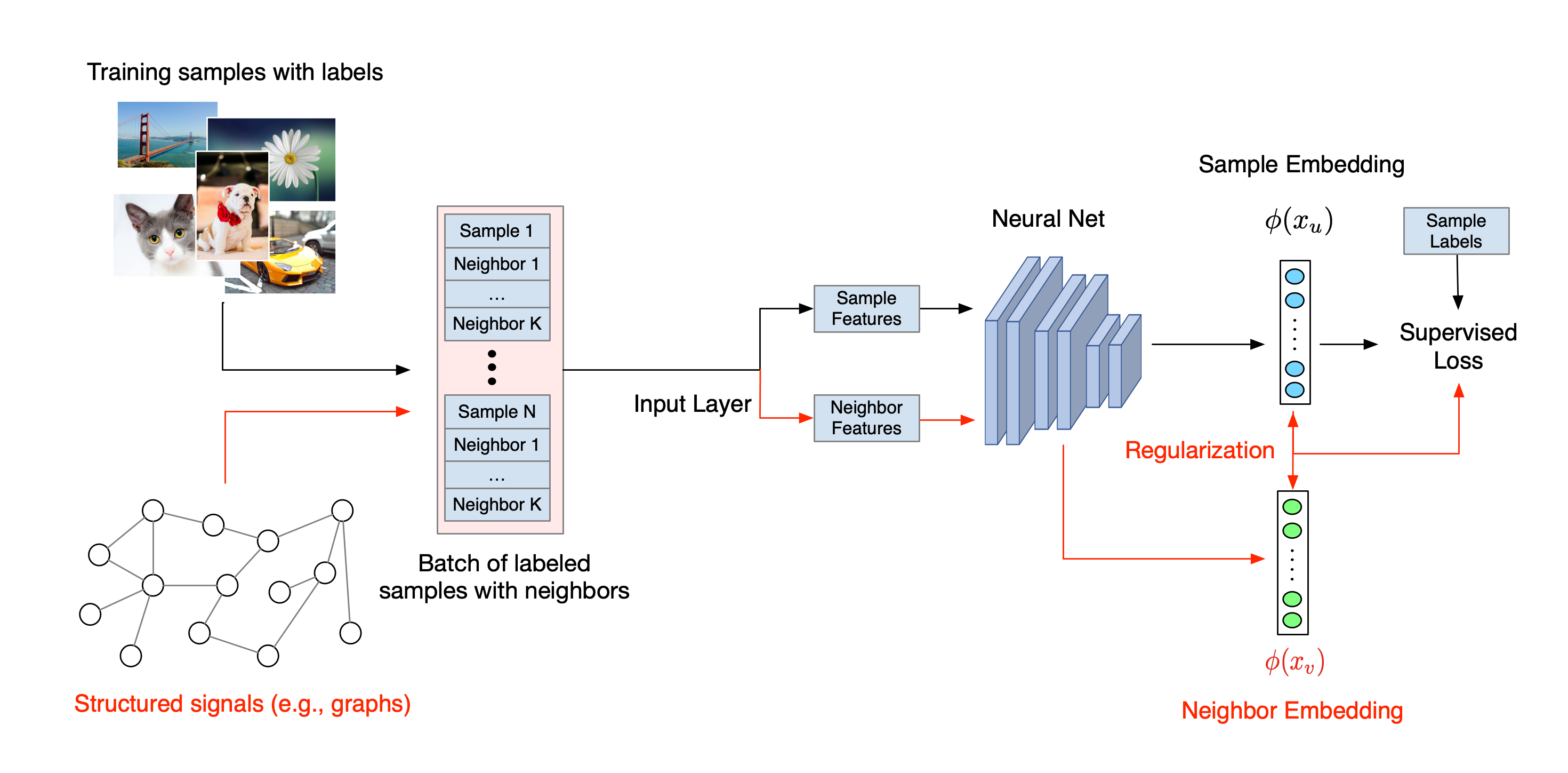

זרימת העבודה הכוללת עבור למידה מובנית עצבית מומחשת להלן. חיצים שחורים מייצגים את זרימת העבודה הרגילה של האימון וחצים אדומים מייצגים את זרימת העבודה החדשה כפי שהוצג על ידי NSL כדי למנף אותות מובנים. ראשית, דגימות האימון מוגדלות כדי לכלול אותות מובנים. כאשר אותות מובנים אינם מסופקים במפורש, הם יכולים להיבנות או להיגרם (האחרון חל על למידה אדוורסרית). לאחר מכן, דגימות האימון המוגברות (כולל הן דגימות מקוריות והן שכנותיהן) מוזנות לרשת העצבית לחישוב ההטבעות שלהן. המרחק בין הטבעה של מדגם להטבעה של שכנתו מחושב ומשמש כהפסד השכן, אשר מטופל כמונח הסדרה ומתווסף להפסד הסופי. להסדרה מפורשת מבוססת שכן, אנו בדרך כלל מחשבים את הפסד השכן כמרחק בין הטבעה של המדגם להטבעה של השכן. עם זאת, ניתן להשתמש בכל שכבה של הרשת העצבית כדי לחשב את אובדן השכן. מצד שני, עבור רגוליזציה מושרה מבוססת שכן (אדברסרית), אנו מחשבים את הפסד השכן כמרחק בין חיזוי התפוקה של השכן היריב המושרה לבין תווית האמת הקרקעית.

למה להשתמש ב-NSL?

NSL מביאה את היתרונות הבאים:

- דיוק גבוה יותר : האות/ים המובנים בין הדגימות יכולים לספק מידע שלא תמיד זמין בכניסות תכונה; לפיכך, הוכח כי גישת האימון המשותף (עם אותות מובנים ותכונות) מתגברת על שיטות קיימות רבות (המסתמכות על אימון עם תכונות בלבד) במגוון רחב של משימות, כגון סיווג מסמכים וסיווג כוונות סמנטי ( Bui et al. ., WSDM'18 & Kipf et al., ICLR'17 ).

- עמידה : מודלים שאומנו עם דוגמאות יריבות הוכחו כעמידים בפני הפרעות יריבות שנועדו להטעות חיזוי או סיווג של מודל ( Goodfellow et al., ICLR'15 & Miyato et al., ICLR'16 ). כאשר מספר דגימות האימון קטן, אימון עם דוגמאות נגדיות מסייע גם בשיפור דיוק המודל ( Tsipras et al., ICLR'19 ).

- נדרשים פחות נתונים מתויגים : NSL מאפשרת לרשתות עצביות לרתום נתונים מסומנים וגם לא מתויגים, מה שמרחיב את פרדיגמת הלמידה ללמידה מפוקחת למחצה . באופן ספציפי, NSL מאפשר לרשת להתאמן באמצעות נתונים מתויגים כמו בהגדרה המפוקחת, ובמקביל דוחף את הרשת ללמוד ייצוגים נסתרים דומים עבור "הדגימות השכנות" שעשויות להכיל תוויות או לא. טכניקה זו הראתה הבטחה גדולה לשיפור דיוק המודל כאשר כמות הנתונים המסומנים קטנה יחסית ( Bui et al., WSDM'18 & Miyato et al., ICLR'16 ).

הדרכות שלב אחר שלב

כדי לקבל ניסיון מעשי עם למידה מובנית עצבית, יש לנו הדרכות המכסות תרחישים שונים שבהם אותות מובנים עשויים להינתן, לבנות או לעורר במפורש. הנה כמה:

הסדרת גרפים לסיווג מסמכים באמצעות גרפים טבעיים . במדריך זה, אנו חוקרים את השימוש בהסדרת גרפים כדי לסווג מסמכים היוצרים גרף טבעי (אורגני).

הסדרת גרפים לסיווג סנטימנטים באמצעות גרפים מסונתזים . במדריך זה, אנו מדגימים את השימוש בהסדרת גרפים לסיווג רגשות ביקורת סרטים על ידי בנייה (סינתזה) של אותות מובנים.

למידה יריבות לסיווג תמונה . במדריך זה, אנו חוקרים את השימוש בלמידה אדוורסרית (כאשר אותות מובנים מושרים) כדי לסווג תמונות המכילות ספרות מספריות.

דוגמאות ומדריכים נוספים ניתן למצוא בספריית הדוגמאות של מאגר GitHub שלנו.

,למידה מובנית עצבית (NSL) מתמקדת באימון רשתות עצביות עמוקות על ידי מינוף אותות מובנים (כאשר זמינים) יחד עם כניסות תכונות. כפי שהציגו Bui et al. (WSDM'18) , האותות המובנים הללו משמשים להסדרת האימון של רשת עצבית, מה שמאלץ את המודל ללמוד תחזיות מדויקות (על ידי מזעור אובדן מפוקח), ובו בזמן לשמור על הדמיון המבני של הקלט (על ידי מזעור אובדן השכן) , ראה את האיור למטה). טכניקה זו היא גנרית וניתנת ליישום על ארכיטקטורות עצביות שרירותיות (כגון Feed-Forward NNs, Convolutional NNs ו-NNs Recurrent).

שימו לב שמשוואת אובדן השכנים המוכללת היא גמישה ויכולה להיות בעלת צורות אחרות מלבד זו שהוצגה לעיל. לדוגמה, אנחנו יכולים גם לבחור\(\sum_{x_j \in \mathcal{N}(x_i)}\mathcal{E}(y_i,g_\theta(x_j))\) להיות הפסד השכן, שמחשב את המרחק בין האמת הקרקעית \(y_i\)והתחזית מהשכן \(g_\theta(x_j)\). זה משמש בדרך כלל בלמידה יריבות (Goodfellow et al., ICLR'15) . לכן, NSL מכליל ללמידת גרפים עצביים אם שכנים מיוצגים במפורש על ידי גרף, וללמידה אדוורסרית אם שכנים נגרמות באופן מרומז על ידי הפרעה אדוורסרית.

זרימת העבודה הכוללת עבור למידה מובנית עצבית מומחשת להלן. חיצים שחורים מייצגים את זרימת העבודה הרגילה של האימון וחצים אדומים מייצגים את זרימת העבודה החדשה כפי שהוצג על ידי NSL כדי למנף אותות מובנים. ראשית, דגימות האימון מוגדלות כדי לכלול אותות מובנים. כאשר אותות מובנים אינם מסופקים במפורש, הם יכולים להיבנות או להיגרם (האחרון חל על למידה אדוורסרית). לאחר מכן, דגימות האימון המוגברות (כולל הן דגימות מקוריות והן שכנותיהן) מוזנות לרשת העצבית לחישוב ההטבעות שלהן. המרחק בין הטבעה של מדגם להטבעה של שכנתו מחושב ומשמש כהפסד השכן, אשר מטופל כמונח הסדרה ומתווסף להפסד הסופי. להסדרה מפורשת מבוססת שכן, אנו בדרך כלל מחשבים את הפסד השכן כמרחק בין הטבעה של המדגם להטבעה של השכן. עם זאת, ניתן להשתמש בכל שכבה של הרשת העצבית כדי לחשב את אובדן השכן. מצד שני, עבור רגוליזציה מושרה מבוססת שכן (אדברסרית), אנו מחשבים את הפסד השכן כמרחק בין חיזוי התפוקה של השכן היריב המושרה לבין תווית האמת הקרקעית.

למה להשתמש ב-NSL?

NSL מביאה את היתרונות הבאים:

- דיוק גבוה יותר : האות/ים המובנים בין הדגימות יכולים לספק מידע שלא תמיד זמין בכניסות תכונה; לפיכך, הוכח כי גישת האימון המשותף (עם אותות מובנים ותכונות) מתגברת על שיטות קיימות רבות (המסתמכות על אימון עם תכונות בלבד) במגוון רחב של משימות, כגון סיווג מסמכים וסיווג כוונות סמנטי ( Bui et al. ., WSDM'18 & Kipf et al., ICLR'17 ).

- עמידה : מודלים שאומנו עם דוגמאות יריבות הוכחו כעמידים בפני הפרעות יריבות שנועדו להטעות חיזוי או סיווג של מודל ( Goodfellow et al., ICLR'15 & Miyato et al., ICLR'16 ). כאשר מספר דגימות האימון קטן, אימון עם דוגמאות נגדיות מסייע גם בשיפור דיוק המודל ( Tsipras et al., ICLR'19 ).

- נדרשים פחות נתונים מתויגים : NSL מאפשרת לרשתות עצביות לרתום נתונים מסומנים וגם לא מתויגים, מה שמרחיב את פרדיגמת הלמידה ללמידה מפוקחת למחצה . באופן ספציפי, NSL מאפשר לרשת להתאמן באמצעות נתונים מתויגים כמו בהגדרה המפוקחת, ובמקביל דוחף את הרשת ללמוד ייצוגים נסתרים דומים עבור "הדגימות השכנות" שעשויות להכיל תוויות או לא. טכניקה זו הראתה הבטחה גדולה לשיפור דיוק המודל כאשר כמות הנתונים המסומנים קטנה יחסית ( Bui et al., WSDM'18 & Miyato et al., ICLR'16 ).

הדרכות שלב אחר שלב

כדי לקבל ניסיון מעשי עם למידה מובנית עצבית, יש לנו הדרכות המכסות תרחישים שונים שבהם אותות מובנים עשויים להינתן במפורש, לבנות או לעורר אותות. הנה כמה:

הסדרת גרפים לסיווג מסמכים באמצעות גרפים טבעיים . במדריך זה, אנו חוקרים את השימוש בהסדרת גרפים כדי לסווג מסמכים היוצרים גרף טבעי (אורגני).

הסדרת גרפים לסיווג סנטימנטים באמצעות גרפים מסונתזים . במדריך זה, אנו מדגימים את השימוש בהסדרת גרפים לסיווג רגשות ביקורת סרטים על ידי בנייה (סינתזה) של אותות מובנים.

למידה יריבות לסיווג תמונה . במדריך זה, אנו חוקרים את השימוש בלמידה אדוורסרית (כאשר אותות מובנים מושרים) כדי לסווג תמונות המכילות ספרות מספריות.

דוגמאות ומדריכים נוספים ניתן למצוא בספריית הדוגמאות של מאגר GitHub שלנו.

,למידה מובנית עצבית (NSL) מתמקדת באימון רשתות עצביות עמוקות על ידי מינוף אותות מובנים (כאשר זמינים) יחד עם כניסות תכונות. כפי שהציגו Bui et al. (WSDM'18) , האותות המובנים הללו משמשים להסדרת האימון של רשת עצבית, מה שמאלץ את המודל ללמוד תחזיות מדויקות (על ידי מזעור אובדן מפוקח), ובו בזמן לשמור על הדמיון המבני של הקלט (על ידי מזעור אובדן השכן) , ראה את האיור למטה). טכניקה זו היא גנרית וניתנת ליישום על ארכיטקטורות עצביות שרירותיות (כגון Feed-Forward NNs, Convolutional NNs ו-NNs Recurrent).

שימו לב שמשוואת אובדן השכנים המוכללת היא גמישה ויכולה להיות בעלת צורות אחרות מלבד זו שהוצגה לעיל. לדוגמה, אנחנו יכולים גם לבחור\(\sum_{x_j \in \mathcal{N}(x_i)}\mathcal{E}(y_i,g_\theta(x_j))\) להיות הפסד השכן, שמחשב את המרחק בין האמת הקרקעית \(y_i\)והתחזית מהשכן \(g_\theta(x_j)\). זה משמש בדרך כלל בלמידה יריבות (Goodfellow et al., ICLR'15) . לכן, NSL מכליל ללמידת גרפים עצביים אם שכנים מיוצגים במפורש על ידי גרף, וללמידה אדוורסרית אם שכנים נגרמות באופן מרומז על ידי הפרעה אדוורסרית.

זרימת העבודה הכוללת עבור למידה מובנית עצבית מומחשת להלן. חיצים שחורים מייצגים את זרימת העבודה הרגילה של האימון וחצים אדומים מייצגים את זרימת העבודה החדשה כפי שהוצג על ידי NSL כדי למנף אותות מובנים. ראשית, דגימות האימון מוגדלות כדי לכלול אותות מובנים. כאשר אותות מובנים אינם מסופקים במפורש, הם יכולים להיבנות או להיגרם (האחרון חל על למידה אדוורסרית). לאחר מכן, דגימות האימון המוגברות (כולל הן דגימות מקוריות והן שכנותיהן) מוזנות לרשת העצבית לחישוב ההטבעות שלהן. המרחק בין הטבעה של מדגם להטבעה של שכנתו מחושב ומשמש כהפסד השכן, אשר מטופל כמונח הסדרה ומתווסף להפסד הסופי. להסדרה מפורשת מבוססת שכן, אנו בדרך כלל מחשבים את הפסד השכן כמרחק בין הטבעה של המדגם להטבעה של השכן. עם זאת, ניתן להשתמש בכל שכבה של הרשת העצבית כדי לחשב את אובדן השכן. מצד שני, עבור רגוליזציה מושרה מבוססת שכן (אדברסרית), אנו מחשבים את הפסד השכן כמרחק בין חיזוי התפוקה של השכן היריב המושרה לבין תווית האמת הקרקעית.

למה להשתמש ב-NSL?

NSL מביאה את היתרונות הבאים:

- דיוק גבוה יותר : האות/ים המובנים בין הדגימות יכולים לספק מידע שלא תמיד זמין בכניסות תכונה; לפיכך, הוכח שגישת האימון המשותף (עם אותות מובנים ותכונות) מתגברת על שיטות קיימות רבות (המסתמכות על אימון עם תכונות בלבד) במגוון רחב של משימות, כגון סיווג מסמכים וסיווג כוונות סמנטי ( Bui et al. ., WSDM'18 & Kipf et al., ICLR'17 ).

- עמידה : מודלים שאומנו עם דוגמאות יריבות הוכחו כעמידים בפני הפרעות יריבות שנועדו להטעות חיזוי או סיווג של מודל ( Goodfellow et al., ICLR'15 & Miyato et al., ICLR'16 ). כאשר מספר דגימות האימון קטן, אימון עם דוגמאות יריבות גם עוזר לשפר את דיוק המודל ( Tsipras et al., ICLR'19 ).

- נדרשים פחות נתונים מתויגים : NSL מאפשרת לרשתות עצביות לרתום נתונים מסומנים וגם לא מתויגים, מה שמרחיב את פרדיגמת הלמידה ללמידה מפוקחת למחצה . באופן ספציפי, NSL מאפשר לרשת להתאמן באמצעות נתונים מתויגים כמו בהגדרה המפוקחת, ובמקביל דוחף את הרשת ללמוד ייצוגים נסתרים דומים עבור "הדגימות השכנות" שעשויות להכיל תוויות או לא. טכניקה זו הראתה הבטחה גדולה לשיפור דיוק המודל כאשר כמות הנתונים המסומנים קטנה יחסית ( Bui et al., WSDM'18 & Miyato et al., ICLR'16 ).

הדרכות שלב אחר שלב

כדי לקבל ניסיון מעשי עם למידה מובנית עצבית, יש לנו הדרכות המכסות תרחישים שונים שבהם אותות מובנים עשויים להינתן, לבנות או לעורר במפורש. הנה כמה:

הסדרת גרפים לסיווג מסמכים באמצעות גרפים טבעיים . במדריך זה, אנו חוקרים את השימוש בהסדרת גרפים כדי לסווג מסמכים היוצרים גרף טבעי (אורגני).

הסדרת גרפים לסיווג סנטימנטים באמצעות גרפים מסונתזים . במדריך זה, אנו מדגימים את השימוש בהסדרת גרפים לסיווג רגשות ביקורת סרטים על ידי בנייה (סינתזה) של אותות מובנים.

למידה יריבות לסיווג תמונה . במדריך זה, אנו חוקרים את השימוש בלמידה אדוורסרית (כאשר אותות מובנים מושרים) כדי לסווג תמונות המכילות ספרות מספריות.

דוגמאות ומדריכים נוספים ניתן למצוא בספריית הדוגמאות של מאגר GitHub שלנו.