- Descrizione :

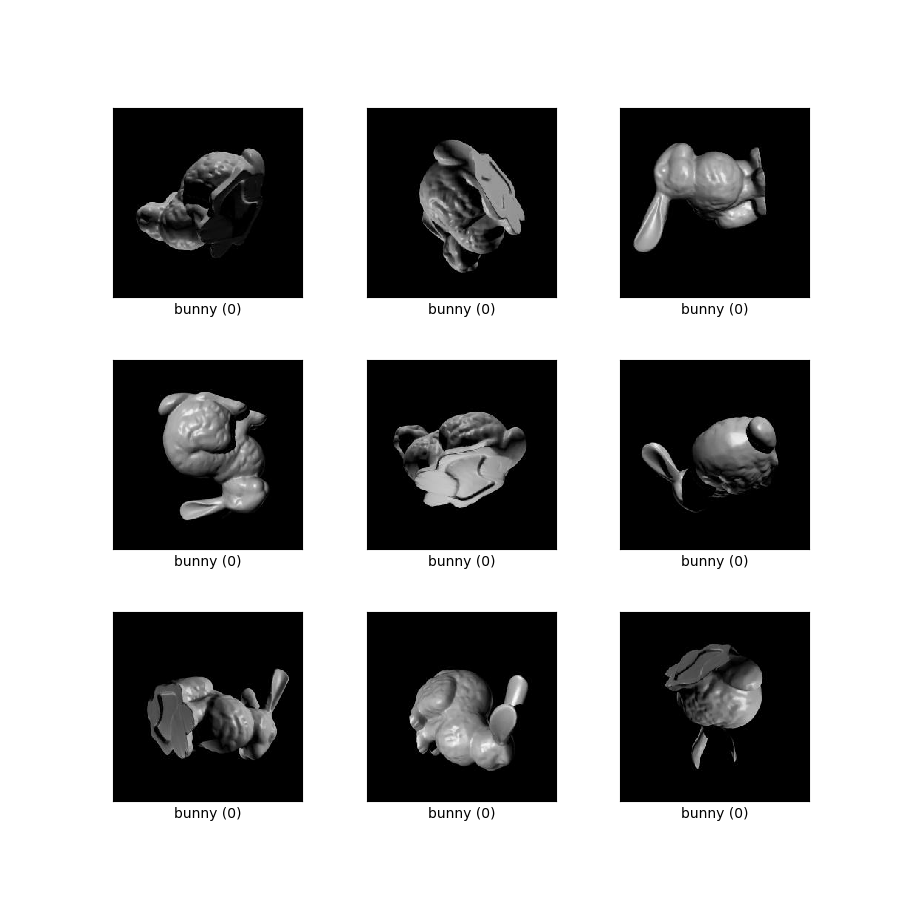

Il set di dati è stato descritto per la prima volta nella sezione "Stanford 3D Objects" del documento Disentangling by Subspace Diffusion . I dati sono costituiti da 100.000 rendering ciascuno degli oggetti Bunny e Dragon dal repository di scansione 3D di Stanford . Altri oggetti potrebbero essere aggiunti in futuro, ma nel documento vengono utilizzati solo il coniglietto e il drago. Ogni oggetto viene renderizzato con un'illuminazione campionata uniformemente da un punto sulla 2-sfera e una rotazione 3D campionata uniformemente. I veri stati latenti vengono forniti come array NumPy insieme alle immagini. L'illuminazione è data come un trivettore con norma unitaria, mentre la rotazione è data sia come quaternione che come matrice ortogonale 3x3.

Esistono molte somiglianze tra S3O4D e i set di dati di benchmark ML esistenti come NORB , 3D Chairs , 3D Shapes e molti altri, che includono anche rendering di un insieme di oggetti in diverse pose e condizioni di illuminazione. Tuttavia, nessuno di questi set di dati esistenti include l' intera gamma di rotazioni in 3D: la maggior parte include solo un sottoinsieme di modifiche all'elevazione e all'azimut. Le immagini S3O4D vengono campionate in modo uniforme e indipendente dall'intero spazio di rotazioni e illuminazioni, il che significa che il set di dati contiene oggetti capovolti e illuminati da dietro o da sotto. Riteniamo che ciò renda S3O4D particolarmente adatto per la ricerca su modelli generativi in cui lo spazio latente ha una topologia non banale, nonché per metodi generali di apprendimento delle varietà in cui la curvatura della varietà è importante.

Documentazione aggiuntiva : esplora documenti con codice

Pagina iniziale : https://github.com/deepmind/deepmind-research/tree/master/geomancer#stanford-3d-objects-for-disentangling-s3o4d

Codice sorgente :

tfds.datasets.s3o4d.BuilderVersioni :

-

1.0.0(impostazione predefinita): versione iniziale.

-

Dimensione download :

911.68 MiBDimensione del set di dati :

1.01 GiBMemorizzazione nella cache automatica ( documentazione ): No

Divide :

| Diviso | Esempi |

|---|---|

'bunny_test' | 20.000 |

'bunny_train' | 80.000 |

'dragon_test' | 20.000 |

'dragon_train' | 80.000 |

- Struttura delle caratteristiche :

FeaturesDict({

'illumination': Tensor(shape=(3,), dtype=float32),

'image': Image(shape=(256, 256, 3), dtype=uint8),

'label': ClassLabel(shape=(), dtype=int64, num_classes=2),

'pose_mat': Tensor(shape=(3, 3), dtype=float32),

'pose_quat': Tensor(shape=(4,), dtype=float32),

})

- Documentazione delle funzionalità :

| Caratteristica | Classe | Forma | Tipo D | Descrizione |

|---|---|---|---|---|

| CaratteristicheDict | ||||

| illuminazione | Tensore | (3,) | float32 | |

| Immagine | Immagine | (256, 256, 3) | uint8 | |

| etichetta | ClassLabel | int64 | ||

| pose_mat | Tensore | (3, 3) | float32 | |

| posa_quat | Tensore | (4,) | float32 |

Chiavi supervisionate (vedi il documento

as_supervised):NoneFigura ( tfds.show_examples ):

- Esempi ( tfds.as_dataframe ):

- Citazione :

@article{pfau2020disentangling,

title={Disentangling by Subspace Diffusion},

author={Pfau, David and Higgins, Irina and Botev, Aleksandar and Racani\`ere,

S{\'e}bastian},

journal={Advances in Neural Information Processing Systems (NeurIPS)},

year={2020}

}