- Descripción :

El conjunto de datos se describió por primera vez en la sección "Objetos 3D de Stanford" del artículo Disentangling by Subspace Diffusion . Los datos consisten en 100.000 representaciones de cada uno de los objetos Bunny y Dragon del repositorio de escaneo 3D de Stanford . Es posible que se agreguen más objetos en el futuro, pero solo Bunny y Dragon se usan en el documento. Cada objeto se renderiza con una iluminación muestreada uniformemente desde un punto en la esfera 2 y una rotación 3D muestreada uniformemente. Los verdaderos estados latentes se proporcionan como matrices NumPy junto con las imágenes. La iluminación se proporciona como un vector de 3 con norma unitaria, mientras que la rotación se proporciona tanto como un cuaternión como una matriz ortogonal de 3x3.

Hay muchas similitudes entre S3O4D y los conjuntos de datos de referencia de ML existentes como NORB , 3D Chairs , 3D Shapes y muchos otros, que también incluyen representaciones de un conjunto de objetos en diferentes poses y condiciones de iluminación. Sin embargo, ninguno de estos conjuntos de datos existentes incluye la variedad completa de rotaciones en 3D; la mayoría incluye solo un subconjunto de cambios en la elevación y el acimut. Las imágenes S3O4D se muestrean de manera uniforme e independiente del espacio completo de rotaciones e iluminaciones, lo que significa que el conjunto de datos contiene objetos que están al revés e iluminados por detrás o por debajo. Creemos que esto hace que S3O4D sea especialmente adecuado para la investigación de modelos generativos donde el espacio latente tiene una topología no trivial, así como para métodos generales de aprendizaje de variedades donde la curvatura de la variedad es importante.

Página de inicio: https://github.com/deepmind/deepmind-research/tree/master/geomancer#stanford-3d-objects-for-disentangling-s3o4d

Código fuente :

tfds.image.s3o4d.S3O4DVersiones :

-

1.0.0(predeterminado): versión inicial.

-

Tamaño de la descarga :

911.68 MiBTamaño del conjunto de datos :

1.01 GiBAlmacenamiento automático en caché ( documentación ): No

Divisiones :

| Separar | Ejemplos |

|---|---|

'bunny_test' | 20,000 |

'bunny_train' | 80.000 |

'dragon_test' | 20,000 |

'dragon_train' | 80.000 |

- Características :

FeaturesDict({

'illumination': Tensor(shape=(3,), dtype=tf.float32),

'image': Image(shape=(256, 256, 3), dtype=tf.uint8),

'label': ClassLabel(shape=(), dtype=tf.int64, num_classes=2),

'pose_mat': Tensor(shape=(3, 3), dtype=tf.float32),

'pose_quat': Tensor(shape=(4,), dtype=tf.float32),

})

Claves supervisadas (Ver

as_superviseddoc ):NoneCita :

@article{pfau2020disentangling,

title={Disentangling by Subspace Diffusion},

author={Pfau, David and Higgins, Irina and Botev, Aleksandar and Racani\`ere,

S{\'e}bastian},

journal={Advances in Neural Information Processing Systems (NeurIPS)},

year={2020}

}

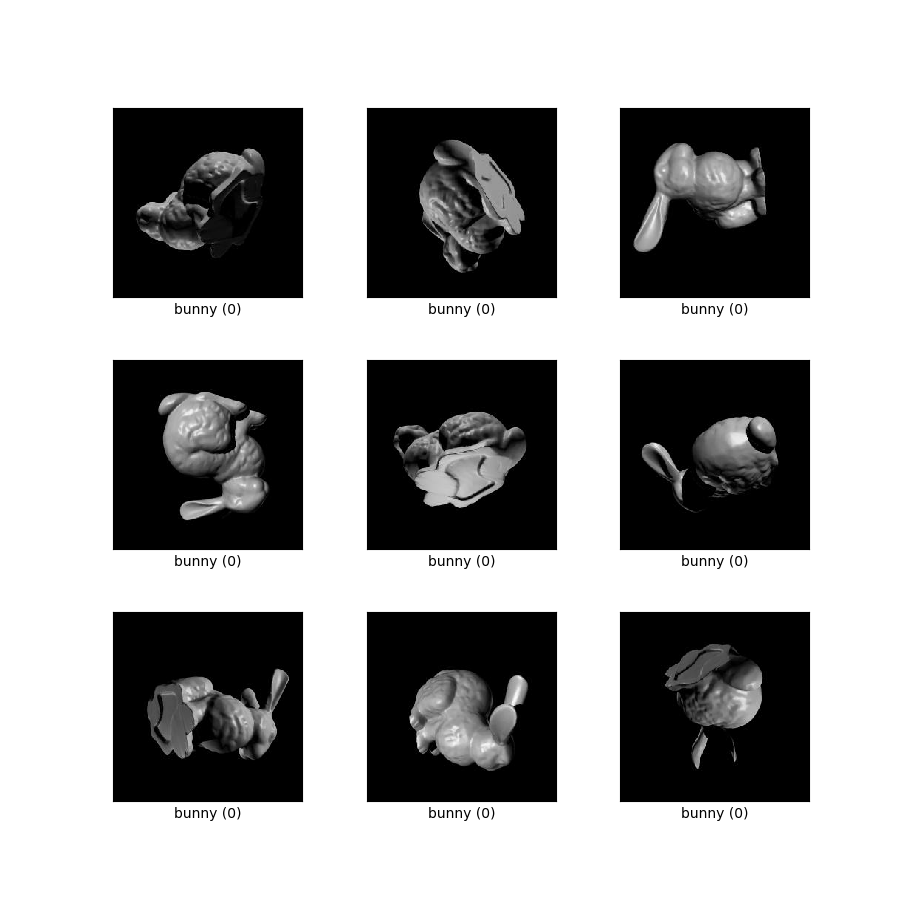

- Figura ( tfds.show_examples ):

- Ejemplos ( tfds.as_dataframe ):